文/孙鹏越

编辑/大风

8月8日,全球计算机业内最重要的圆桌会议,世界计算机图形学会议SIGGRAPH正式召开。

NVIDIA创始人兼CEO黄仁勋出席,并带来了新一代英伟达超级AI芯片GH200。黄仁勋对自己的新旗舰产品非常有自信,将GH200称为“世界上最快的内存”。

在如今的AI市场,英伟达是堪称“运转整个AI世界的中心”。不论是OpenAI还是谷歌、META、百度、腾讯、阿里巴巴,所有的生成式AI都极度依赖英伟达的AI芯片来训练。

并且,据媒体报道,英伟达AI芯片H100在2023年8月的市场总需求可能在43.2万张左右,而目前一张H100芯片在Ebay上的价格甚至炒到了4.5万美元,折合人民币超过了30万元。

40多万张芯片缺口,单价4.5万美元,总价轻轻松松上数百万美元。

英伟达,正在经历一场比“挖矿时代”更疯狂的市场浪潮。

AI芯片,一张难求

所谓的AI芯片,其实是图形处理器(GPU),主要作用是帮助运行训练和部署人工智能算法所涉及的无数计算。

也就是说,生成式AI的种种智能表现,均来自于无数GPU的堆砌。使用的芯片越多,生成式AI就越智能。

OpenAI对GPT-4训练细节守口如瓶,但据媒体猜测,GPT-4至少需要8192张H100芯片,以每小时2美元的价格,在约55天内可以完成预训练,成本约为2150万美元(1.5亿人民币)。

据微软高管透露,为ChatGPT提供算力支持的AI超级计算机,是微软在2019年投资10亿美元建造一台大型顶尖超级计算机,配备了数万个英伟达A100 GPU,还配备了60多个数据中心总共部署了几十万个英伟达GPU辅助。

ChatGPT所需要的AI芯片并不是固定的,而是逐次递增。ChatGPT越聪明,背后的代价是所需算力越来越多。据摩根士丹利预测,到了GPT-5大概需要使用2.5万个GPU,约是GPT-4的三倍之多。

如果想满足OpenAI、谷歌等一系列AI产品的需求,那么就相当于英伟达一家公司为全世界的AI产品供芯,这对于英伟达的产能是个极大的考验。

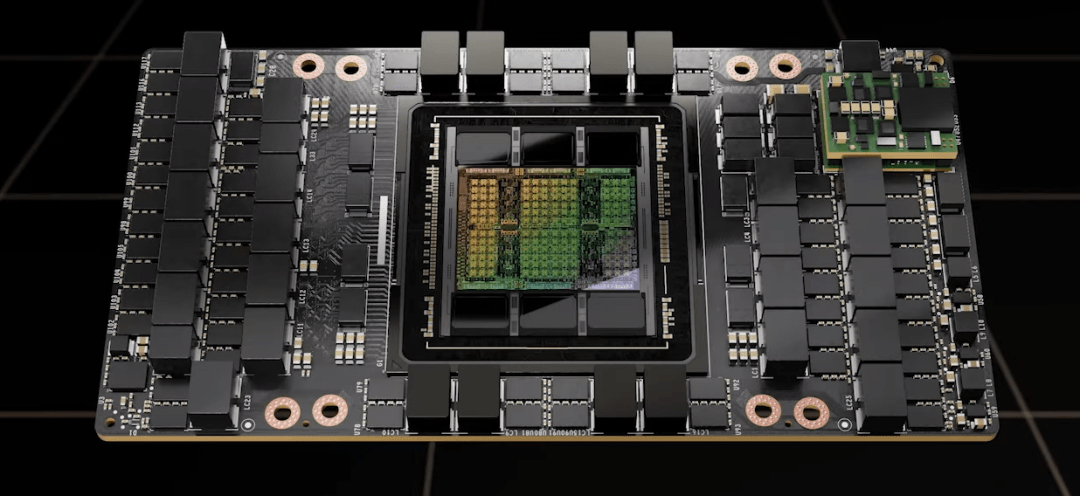

![]() 英伟达H100

英伟达H100

虽然英伟达正在开足马力生产AI芯片,但据媒体报道,小型和大型云提供商的大规模H100集群容量即将耗尽,H100的“严重缺货问题”至少会持续到2024年底。

目前,英伟达作用于AI市场的芯片主要分为H100和A100两种,H100是旗舰款产品,从技术细节来说,H100比A100在16位推理速度大约快3.5倍,16位训练速度大约快2.3倍。

不论是H100还是A100,全部都是由台积电合作生产,就使得H100的生产受到了限制。有媒体称,每一张H100从生产到出厂大约需要半年的时间,生产效率非常的缓慢。

英伟达曾表示它们在2023年下半年,提高对AI芯片的供应能力,但没有提供任何定量的信息。

不少公司和求购者都在呼吁,要求英伟达加大对晶圆厂的生产数量,不只和台积电合作,而是把更多的订单交给三星和英特尔。

更快的训练速度

如果没办法提高产能,那么最好的解决办法就是推出性能更高的芯片,以质取胜。

于是乎,英伟达开始频频推出新款GPU用来提升AI训练能力。先是在今年3月,英伟达发布了H100 NVL GPU、L4 Tensor Core GPU、L40 GPU、NVIDIA Grace Hopper四款AI芯片,以满足生成式AI们日益增长的算力需求。

在上一代还未量产上市,英伟达又在8月8日世界计算机图形学会议SIGGRAPH上,由黄仁勋发布了H100的升级版,GH200。

据了解,全新GH200 Grace Hopper Superchip基于72核Grace CPU,配备480GB ECC LPDDR5X内存以及GH100计算GPU,搭配141GB HBM3E内存,采用6个24GB堆栈,使用6144位存储器接口。

![]() 英伟达GH200

英伟达GH200

GH200最大的黑科技,就是作为世界上第一款配备HBM3e内存的芯片,能够将其本地GPU内存增加50%。而这也是专门对人工智能市场做的“特定升级”,因为顶级生成式AI往往尺寸巨大却内存容量有限。

据公开资料显示,HBM3e内存是SK海力士的第五代高带宽内存,是一种新型的高带宽内存技术,可以在更小的空间内提供更高的数据传输速率。它的容量为141GB,带宽为每秒5TB,能分别达到H100的1.7倍和1.55倍。

从7月份发布以来,SK海力士就成为GPU市场的宠儿,领先于直接竞争对手英特尔Optane DC和三星的Z-NAND闪存芯片。

值得一提的是,SK海力士一直以来都是英伟达的合作伙伴之一,从HBM3内存开始,英伟达绝大部分产品都是采用SK海力士的产品。但SK海力士对于AI芯片所需要的内存一直产能堪忧,英伟达不止一次的要求SK海力士提高产能。

一个难产大户遇上另一个难产大户,不由让人担心GH200的产能。

NVIDIA官方表示,GH200与当前一代产品H100相比,内存容量高出3.5倍,带宽高出3倍;并且,HBM3e内存将使下一代GH200运行AI模型的速度比当前模型快3.5倍。

比H100运行AI模型的速度快3.5倍,是否意味着,1张GH200就能相当于3.5张H100?一切都还得实践操作才能得知。

但目前来说,可以肯定的一点就是,作为AI市场的最大供应商,英伟达进一步巩固了自己领先位置,并和AMD和英特尔拉大了差距。

英伟达的对手们

面对43万张AI芯片缺口,没有一家公司不动心。尤其是英伟达的最大竞争对手AMD和英特尔,不会放任其一个人独吞整个市场。

今年6月14日,AMD董事会主席、CEO苏姿丰密集地发布了多款AI软硬件新品,包括针对大语言模型设计的AI芯片,MI300X。正式拉开在AI市场,对英伟达的正面挑战。

在硬件参数上,AMD MI300X拥有多达13颗小芯片,总共包含1460亿个晶体管,配置128GB的HBM3内存。其HBM密度为英伟达H100的2.4倍,带宽为英伟达H100的1.6倍,意味着可加快生成式AI的处理速度。

但可惜的是,这款旗舰AI芯片并没有现货,只是预计将于2023年Q4季度全面量产。

而另一竞争对手英特尔,则在2019年就以约20亿美元的价格收购了人工智能芯片制造商HABANA实验室,进军AI芯片市场。

今年8月,在英特尔最近的财报电话会议上,英特尔首席执行官Pat Gelsinger表示,英特尔正在研发下一代Falcon Shores AI超算芯片,暂定名为Falcon Shores 2,该芯片预计将于2026年发布。

除了Falcon Shores 2之外,英特尔还推出AI芯片Gaudi2,已经开始销售,而Gaudi3则正在开发中。

只是可惜的是,Gaudi2芯片规格并不高,难以实现对英伟达H100和A100发起挑战。

![]() AMD MI300X

AMD MI300X

除了国外半导体巨头们大秀肌肉,开始了“芯片竞争”之外,国内的半导体公司也开始了对AI芯片的研发。

其中,昆仑芯AI加速卡RG800、天数智芯的天垓100加速卡、燧原科技第二代训练产品云燧T20/T21,均表示能够具有支持大模型训练的能力。

在这场以算力为标准,以AI大模型为战场的芯片之争,英伟达作为AI市场的最大赢家之一,已经在芯片设计和市场占比等方面展示出它的强大。

但国产AI芯片虽然稍稍落后,但研发和扩展市场的脚步从未停止,未来值得期待

betting on belmont stakes online

seneca niagara casino sports betting

betting football tips

发布于:浙江省

声明:该文观点仅代表作者本人,搜狐号系信息发布平台,搜狐仅提供信息存储空间服务。